GPT-OSS Model Card 解析

为什么值得关注

gpt-oss-120b

1170亿参数,性能接近 o4-mini

gpt-oss-20b

210亿参数,16GB内存即可运行

智能体功能

函数调用、网页浏览、代码执行

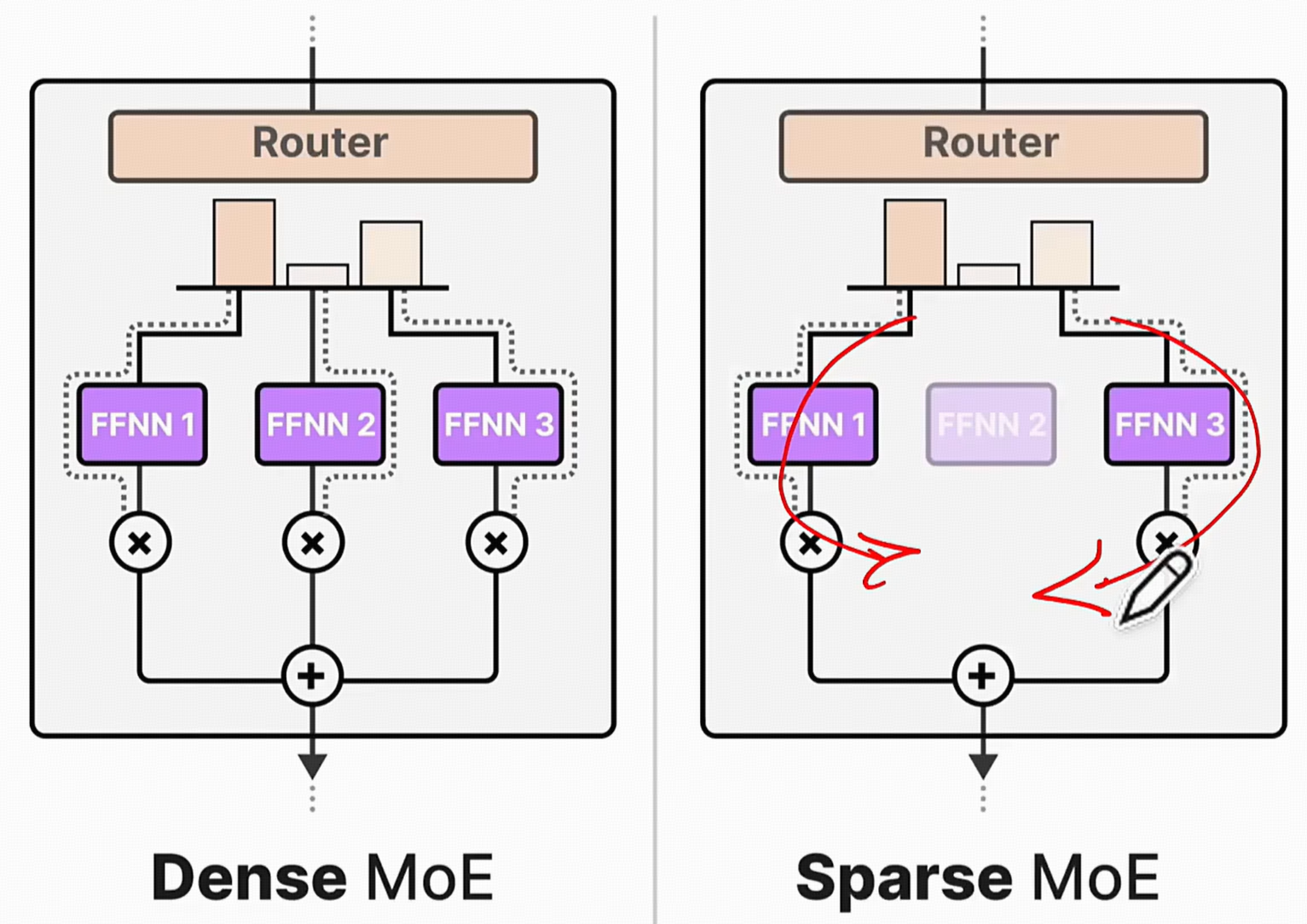

混合专家架构

用稀疏激活降低单次推理成本

API兼容

降低迁移到开放权重模型的工程摩擦

本地部署

把部分推理负载带回自有设备或基础设施

1. 核心定位:OpenAI重新进入开放权重竞争

1.1 发布背景:开放生态压力下的战略回摆

2025年8月6日,OpenAI 宣布推出其最新的开源模型系列——GPT-OSS(GPT Open Source Software)。表面上看,这是一次模型发布;更深层看,它是OpenAI在闭源API能力、开放权重生态和本地部署需求之间重新寻找平衡。此次发布的模型是自2019年GPT-2以来,OpenAI首次公开发布开放权重的语言模型,这一举动在业界引起了广泛关注和讨论[24][22]。

OpenAI首席执行官山姆·奥尔特曼(Sam Altman)

"数十亿美元研究的成果"

性能可与公司自家的闭源模型相媲美,同时能够在本地设备上运行

此次开放权重行动被广泛解读为对当前AI领域竞争格局的直接回应,特别是面对Meta的Llama系列、Mistral AI以及中国初创公司DeepSeek等在开放模型领域的激烈竞争[39] [43]。奥尔特曼此前曾承认,OpenAI在开源技术方面"站在了历史的错误一边",而GPT-OSS的发布正是对这一战略的修正和回归[43]。

因此,GPT-OSS的意义不仅是多了两个可下载模型,更在于它改变了开发者评估OpenAI生态的方式:闭源API不再是唯一入口,本地运行、私有部署和二次定制也成为可讨论的选项[42]。通过提供高性能的开放权重模型,OpenAI旨在赋能从个人开发者到大型企业乃至政府机构的广泛用户群体,使他们能够在自有基础设施上运行、定制和构建AI应用[21]。

1.2 模型系列:gpt-oss-120b 与 gpt-oss-20b

gpt-oss-120b

2. 技术规格:用MoE把总参数与激活成本拆开

2.1 核心架构:混合专家让“大模型”不必每次全量计算

2.2 注意力优化:长上下文能力必须服务于推理效率

2.3 位置编码与上下文长度

3. 性能表现:基准分数之外,还要看可部署性

3.1 推理能力评估

3.2 关键基准测试成绩

3.3 推理速度与效率

4. 功能特性:从聊天模型走向可调用工具的本地智能体

4.1 核心功能

4.2 智能体 (Agentic) 能力

4.3 API 兼容性

5. 部署方式:开放权重的价值最终落在运行成本上

5.1 本地部署

5.2 云端部署

GPT-OSS 架构概览

117B 参数"] A --> C["gpt-oss-20b

21B 参数"] B --> D["混合专家架构

MoE with 128 Experts"] C --> E["混合专家架构

Optimized for Efficiency"] D --> F["Transformer 36层

Top-4 路由"] E --> G["轻量级设计

16GB 内存需求"] F --> H["128k 上下文窗口

RoPE 位置编码"] G --> H H --> I["分组多查询注意力

Grouped Query Attention"] I --> J["交替注意力机制

密集+稀疏混合"] J --> K["智能体能力

函数调用/网页浏览"] K --> L["API 兼容性

OpenAI Responses API"] style A fill:#e8f4fd,stroke:#1e40af,stroke-width:3px,color:#1e293b style B fill:#fef3c7,stroke:#f59e0b,stroke-width:3px,color:#92400e style C fill:#dcfce7,stroke:#10b981,stroke-width:3px,color:#065f46 style D fill:#fce7f3,stroke:#ec4899,stroke-width:2px,color:#831843 style E fill:#fce7f3,stroke:#ec4899,stroke-width:2px,color:#831843 style F fill:#f3e8ff,stroke:#8b5cf6,stroke-width:2px,color:#5b21b6 style G fill:#f3e8ff,stroke:#8b5cf6,stroke-width:2px,color:#5b21b6 style H fill:#e8f5e8,stroke:#059669,stroke-width:2px,color:#064e3b style I fill:#fff1f2,stroke:#f43f5e,stroke-width:2px,color:#9f1239 style J fill:#fff1f2,stroke:#f43f5e,stroke-width:2px,color:#9f1239 style K fill:#f8fafc,stroke:#64748b,stroke-width:2px,color:#334155 style L fill:#f8fafc,stroke:#64748b,stroke-width:2px,color:#334155

结论:GPT-OSS是开放生态的信号,不是终局答案

GPT-OSS系列的发布,标志着OpenAI在时隔六年后重新进入开放权重模型竞争。gpt-oss-120b以接近o4-mini的性能切入高性能开放模型市场,gpt-oss-20b则把重点放在消费级设备和本地部署的可行性上。

通过Apache 2.0许可证、智能体能力、API兼容性以及灵活的部署选项,GPT-OSS为开发者提供了新的工程选择:什么时候继续使用闭源API,什么时候转向自有基础设施,什么时候用较小模型换取低延迟和隐私控制。它真正释放的不是单一模型的性能,而是模型选择权、部署权和定制权。

引用

若想引用本文,请使用:

@misc{dong2025gptoss,

author = {Peijie Dong},

title = {GPT-OSS Model Card 解析},

year = {2025},

month = aug,

day = {6},

howpublished = {\url{https://pprp.github.io/tech/gptoss/}},

url = {https://pprp.github.io/tech/gptoss/},

note = {Blog post. Accessed: 2026-04-28},

language = {Chinese}

}