LLM Agent 记忆管理方案

智能记忆

LLM Agent记忆管理

全面解决方案调研

Agent 的关键短板不是“记不住一句话”,而是无法把历史经验变成可检索、可更新、可遗忘的系统资产。本文从外部记忆、内部优化和应用场景三个层面,梳理长期记忆方案的工程取舍。

执行摘要

LLM Agent 的记忆管理,本质上是在回答三个问题:什么信息值得留下,留下后如何被可靠检索,以及什么时候必须忘掉。单靠上下文窗口无法支撑长期交互;单靠微调也难以及时吸收新经验。因此更现实的方案,是把外部辅助工具与内部机制优化结合起来:MemoryBank、向量数据库和知识图谱提供持久化、可扩展的外部记忆;参数高效微调(PEFT)和注意力机制改进提升模型处理长序列和新知识的能力;在对话系统、游戏AI和代码生成等场景中,再根据任务需求定制存储、检索、更新和遗忘策略。

1. 记忆管理的起点:不是存得越多越好

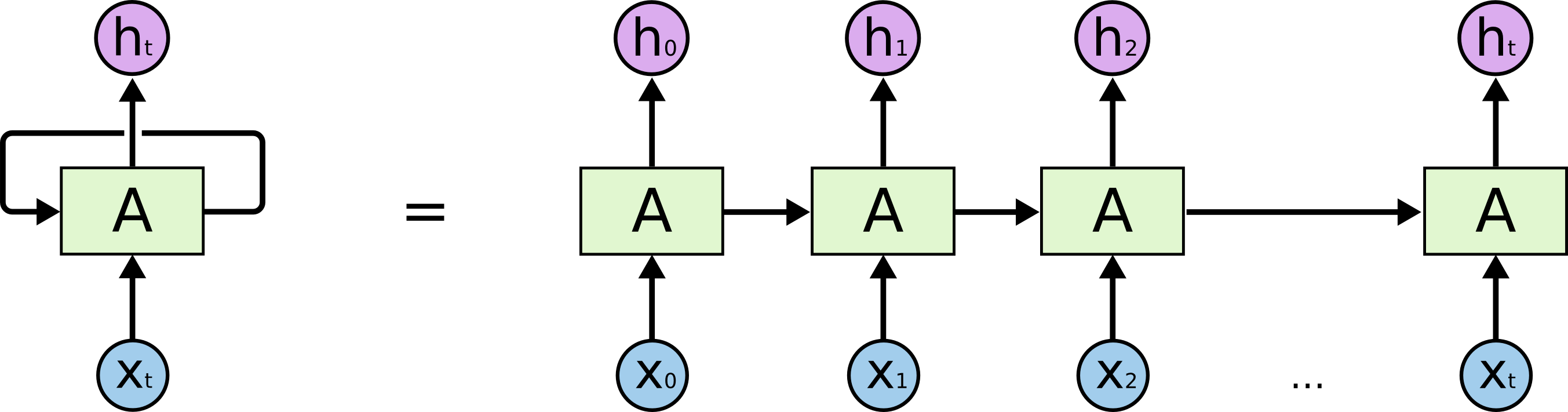

随着大型语言模型(LLM)进入个人伴侣、心理咨询、秘书助理等持续交互场景,它们固有的记忆局限开始变得刺眼336 338。LLM 本身是无状态的,所谓“记忆”通常只存在于当前上下文窗口里。窗口之外的信息既不会自动沉淀,也不会自动校验,更不会自动淘汰。于是问题从“如何让模型记住更多”变成了“如何让 Agent 管理一套可信的长期经验”。

核心挑战

- • 灾难性遗忘问题

- • 错误传播与体验回放错位

- • 上下文窗口限制

- • 知识更新与一致性维护

核心目标

- • 增强记忆容量

- • 提升长期记忆

- • 实现选择性遗忘

- • 保持上下文连贯性

1.1 灾难性遗忘问题 (Catastrophic Forgetting)

灾难性遗忘(Catastrophic Forgetting),又称灾难性干扰,是神经网络在持续学习(Continual Learning)或顺序学习(Sequential Learning)场景中面临的一个根本性难题547。当LLM在新的数据集上进行微调或更新时,其网络权重会发生调整,这可能导致模型在学习新知识的同时,覆盖或破坏其在先前训练阶段已经掌握的重要知识548。

缓解策略分类

基于正则化的方法

通过损失函数中的正则化项限制参数变化,如弹性权重巩固(EWC)

基于回放的方法

训练新任务时重放旧训练样本,包括记忆回放和生成式回放

参数隔离方法

为不同任务分配不同参数,如适配器(Adapters)和LoRA

多阶段训练

使用混合专家(MoE)模型,让不同子网络处理不同领域知识

1.2 错误传播与体验回放错位 (Error Propagation & Misaligned Experience Replay)

除了灾难性遗忘,LLM Agent的记忆系统还面临着由"体验跟随"(Experience-Following)特性带来的两大挑战:错误传播(Error Propagation)和体验回放错位(Misaligned Experience Replay)525。

2. 外部记忆:把状态从模型里拆出来

为了克服 LLM 在记忆容量和持久性上的固有限制,研究者们开始把记忆功能从模型内部转移到外部系统中。这样做的好处很直接:模型负责理解和生成,外部系统负责存储、检索、更新和治理。记忆不再只是 prompt 里的临时文本,而变成 Agent 可以长期维护的一层基础设施。

2.1 记忆库系统 (Memory Bank)

记忆库系统(Memory Bank)是一种专为LLM设计的、用于模拟人类长期记忆的外部机制。MemoryBank是一个具有代表性的框架,它通过模拟人类的记忆过程,为LLM提供了强大的长期记忆能力493。

MemoryBank核心机制

2.2 向量数据库 (Vector Databases)

向量数据库是增强LLM记忆能力的关键技术之一,它通过将文本信息转化为高维向量(即嵌入),实现了对海量数据的快速、准确的语义检索521。

3. 内部优化:让模型更会使用长信息

外部记忆解决的是“信息放在哪里”,内部机制优化解决的是“模型能不能用好这些信息”。如果模型无法稳定处理长序列、无法在新任务学习时保留旧知识,外部检索再强也只能提供原料。因此,模型架构、微调方式和注意力机制仍然是记忆系统的重要组成部分。

3.1 模型架构改进

4. 场景决定记忆策略:同一套机制不能包打天下

在不同应用场景中,LLM Agent 对记忆的需求并不相同。对话系统强调长期关系和个性化,游戏 AI 更看重状态变化和行为连续性,代码生成则需要项目上下文、依赖关系和历史修改记录。有效的记忆方案不能只看存储技术,还要看任务真正需要哪类信息、以什么频率更新、错误记忆会带来多大代价。

4.1 对话系统与AI伴侣

在对话系统和AI伴侣应用中,记忆管理的核心目标是实现长期、连贯且个性化的交互。用户期望AI能够记住他们之前的对话、个人偏好、兴趣甚至情感状态,从而建立起一种类似人与人之间的长期关系。

SiliconFriend实践案例

结论:记忆系统的核心是治理,而不只是扩容

LLM Agent 的记忆管理不应该被简化成“把历史对话全部存进向量库”。真正困难的是治理:哪些信息进入长期记忆,哪些信息只保留在短期上下文,哪些信息需要被降权、删除或重新验证。

外部工具提供容量和可检索性,内部优化提升模型利用信息的能力,场景策略则决定记忆的颗粒度和风险边界。三者缺一不可。只扩容而不筛选,会让错误传播更快;只微调而不外部化,又很难支持快速变化的个人、项目和环境状态。

因此,一个可靠的 Agent 记忆系统,最终不是一个数据库插件,而是一套持续运行的判断机制:记住重要的,淡化过时的,隔离可疑的,并在需要时把历史经验重新带回当前任务。

参考文献

引用

若想引用本文,请使用:

@misc{dong2025agentmem,

author = {Peijie Dong},

title = {LLM Agent 记忆管理方案},

year = {2025},

month = aug,

day = {7},

howpublished = {\url{https://pprp.github.io/tech/agentmem/}},

url = {https://pprp.github.io/tech/agentmem/},

note = {Blog post. Accessed: 2026-04-28},

language = {Chinese}

}