LLM Agent 记忆管理方案

<!DOCTYPE html>

智能记忆

LLM Agent记忆管理

全面解决方案调研

通过外部辅助工具与内部机制优化的协同整合,克服灾难性遗忘、错误传播等挑战,实现记忆容量扩展、长期记忆增强、智能选择性遗忘

执行摘要

LLM Agent记忆管理方案通过结合外部辅助工具和内部机制优化,旨在克服灾难性遗忘、错误传播等挑战,实现记忆容量的扩展、长期记忆的增强和智能化的选择性遗忘。外部工具如记忆库系统(MemoryBank)、向量数据库和知识图谱,为Agent提供了持久化、可扩展的外部记忆。内部优化则通过参数高效微调(PEFT)和改进注意力机制,提升模型自身处理和利用信息的能力。在特定应用场景中,如对话系统、游戏AI和代码生成,记忆管理策略被进一步定制,以满足不同任务对记忆的独特需求,从而构建出更智能、更连贯、更具适应性的AI Agent。

1. 核心挑战与目标:提升长期记忆与防止知识遗忘

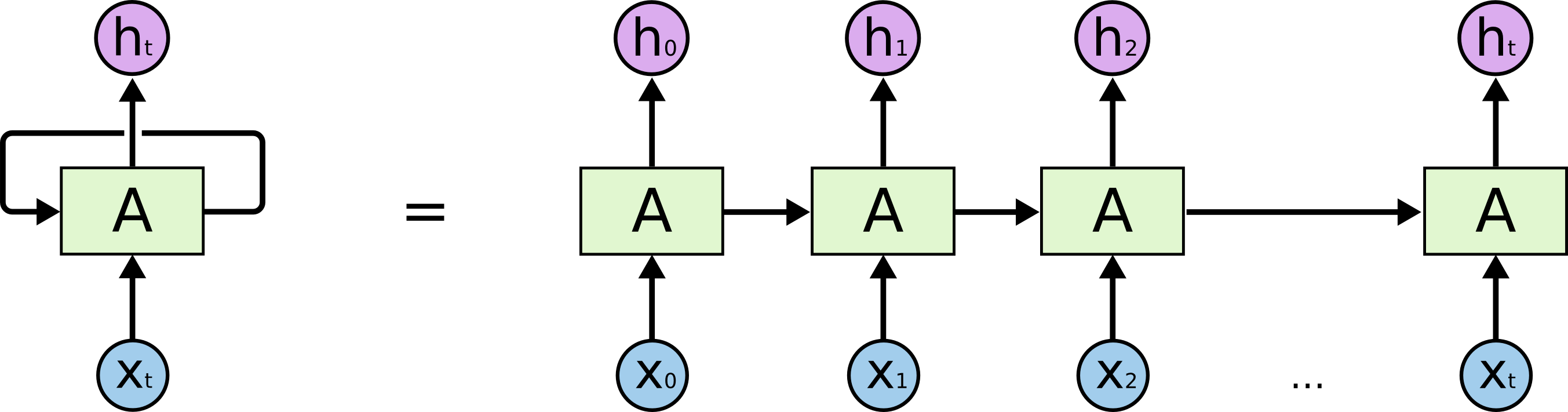

随着大型语言模型(LLM)在各类应用中的普及,其固有的记忆局限性日益凸显。LLM本身是无状态的,其"记忆"仅限于当前对话的上下文窗口,这导致它们在需要持续交互的场景中表现不佳,例如个人伴侣、心理咨询或秘书助理等336 338。这种短期记忆的缺陷使得LLM无法有效利用历史信息,导致用户体验下降,并引发了一系列技术挑战。

核心挑战

- • 灾难性遗忘问题

- • 错误传播与体验回放错位

- • 上下文窗口限制

- • 知识更新与一致性维护

核心目标

- • 增强记忆容量

- • 提升长期记忆

- • 实现选择性遗忘

- • 保持上下文连贯性

1.1 灾难性遗忘问题 (Catastrophic Forgetting)

灾难性遗忘(Catastrophic Forgetting),又称灾难性干扰,是神经网络在持续学习(Continual Learning)或顺序学习(Sequential Learning)场景中面临的一个根本性难题547。当LLM在新的数据集上进行微调或更新时,其网络权重会发生调整,这可能导致模型在学习新知识的同时,覆盖或破坏其在先前训练阶段已经掌握的重要知识548。

缓解策略分类

基于正则化的方法

通过损失函数中的正则化项限制参数变化,如弹性权重巩固(EWC)

基于回放的方法

训练新任务时重放旧训练样本,包括记忆回放和生成式回放

参数隔离方法

为不同任务分配不同参数,如适配器(Adapters)和LoRA

多阶段训练

使用混合专家(MoE)模型,让不同子网络处理不同领域知识

1.2 错误传播与体验回放错位 (Error Propagation & Misaligned Experience Replay)

除了灾难性遗忘,LLM Agent的记忆系统还面临着由"体验跟随"(Experience-Following)特性带来的两大挑战:错误传播(Error Propagation)和体验回放错位(Misaligned Experience Replay)525。

2. 外部辅助工具:扩展LLM的记忆能力

为了克服LLM自身在记忆容量和持久性上的固有限制,研究者们开发了多种外部辅助工具,将记忆功能从模型内部转移到外部系统中。这些工具为LLM Agent提供了强大的长期记忆支持,使其能够存储、检索和管理海量信息。

2.1 记忆库系统 (Memory Bank)

记忆库系统(Memory Bank)是一种专为LLM设计的、用于模拟人类长期记忆的外部机制。MemoryBank是一个具有代表性的框架,它通过模拟人类的记忆过程,为LLM提供了强大的长期记忆能力493。

MemoryBank核心机制

2.2 向量数据库 (Vector Databases)

向量数据库是增强LLM记忆能力的关键技术之一,它通过将文本信息转化为高维向量(即嵌入),实现了对海量数据的快速、准确的语义检索521。

3. 内部机制优化:模型架构与注意力机制

除了引入外部辅助工具,对LLM自身的内部机制进行优化也是提升其记忆管理能力的重要途径。这包括对模型架构的改进和对注意力机制的调整,旨在从根本上增强模型处理和利用长序列信息的能力。

3.1 模型架构改进

4. 特定应用场景下的记忆管理策略

在不同的应用场景中,LLM Agent对记忆的需求和管理策略各不相同。设计有效的记忆管理方案必须紧密结合具体的应用背景,如对话系统、游戏AI、代码生成等不同领域。

4.1 对话系统与AI伴侣

在对话系统和AI伴侣应用中,记忆管理的核心目标是实现长期、连贯且个性化的交互。用户期望AI能够记住他们之前的对话、个人偏好、兴趣甚至情感状态,从而建立起一种类似人与人之间的长期关系。