代码生成被吞噬后,Harness 架构师与“碳基智能体”的崛起

引言:打破“一句话生成 App”的浪漫幻觉

过去这两年,整个软件工程界正沉浸在一种名为“Vibe Coding(意图编程)”的狂热与随之而来的深层焦虑中。随着基础大模型(LLM)原生能力的疯狂进化——百万级上下文、原生多步推理、甚至端到端的代码执行沙箱——“一句话生成一个 App”正从科幻迅速变成现实。在这个看似魔法的时代,那些还在死磕各种玄学 Prompt 技巧、手写简单 RAG 拼接脚本,甚至只会把产品经理的中文需求“人肉翻译”成代码的程序员们,正不可避免地感受到一种被时代无情碾压的窒息感。似乎只要模型再迭代一个大版本,所有人都将失去饭碗。

然而,当我们把视线从社交媒体上光鲜亮丽的“贪吃蛇 Demo”移开,看向那些支撑着真实商业运转、拥有几十万行祖传代码且需求朝令夕改的企业级系统时,这层浪漫的幻觉瞬间破碎。在绝对复杂的物理与商业现实面前,一个没有被严格约束的“裸奔 AI”,不仅无法成为一键解决问题的救世主,反而极易变成引发连锁崩溃的“熵增机器”。

这篇文章,我们将彻底抛开表层的工具焦虑,从计算机科学的第一性原理出发,戳破这层幻觉。我们要探讨的残酷真相是:那些仅仅为了弥补大模型“智商缺陷”的低级脚手架代码确实必将消亡;但是,为了将强大的 AI 降服、使其安全并入复杂现实世界而存在的 Harness Engineering(工程编排与控制边界),不仅不会消失,反而会演变成下一代软件工程的“操作系统”。

在这场生产力的超级重组中,传统的“前端/后端/测试”等工种将被无情抹平。留下来的,将是两类立于新时代潮头的全新物种:掌控系统生杀大权的 “Harness 架构师”,以及游走在业务泥潭中处理非理性现实的 “碳基智能体(Human Agent)”。

即梦生成概念图:从“一句话生成应用”的浪漫想象,到复杂工程里的真实对抗。

即梦生成概念图:从“一句话生成应用”的浪漫想象,到复杂工程里的真实对抗。

第一部分:第一性原理的交锋——概率黑盒 vs 确定性世界

要看清软件工程的未来,我们必须剥离掉 RAG、Agent、Prompt 这些繁杂的流行词汇,回到计算机科学的最底层,审视一场正在发生的物理级碰撞:“概率学”与“确定性”的交锋。

让我们先来看看大语言模型(LLM)的第一性原理。无论 GPT 或是 Claude 的参数量达到多大的天文数字,无论它们的“隐式推理”看起来多么像人类的思考,其底层的数学本质从未改变:它们是基于概率分布预测下一个 Token 的无状态(Stateless)引擎。 这意味着,AI 天生带有“发散”和“妥协”的属性。它是一个极度聪明的黑盒,但它每一次生成代码或推演逻辑,都是在玩一场高维空间的概率游戏。在它的世界里,没有绝对的对错,只有“置信度”的高低。

然而,现实商业世界的第一性原理恰恰完全相反。物理世界、金融账本、数据库的底层架构,是建立在强状态(Stateful)、绝对确定性(Deterministic)和极低容错率之上的。银行的转账接口不能有 99% 的成功率,它必须是 100% 成功或 100% 回滚(即数据库的 ACID 原则);公司的越权访问漏洞不是“大概率没问题”,而是“只要发生一次就会导致灾难”。

当极度聪明的“概率黑盒”一头撞上极其严苛的“确定性世界”时,致命的断层就出现了。你不能指望一个基于概率分布的模型,靠它自己百分之百完美地去改变现实世界中的关键状态。即使模型原生具备了写代码和执行工具的能力,它也无法在神经元网络内部凭空产生对“你们公司昨晚刚制定的退款潜规则”的绝对遵守。

这就是 Harness Engineering(工程编排) 不可能被模型原生能力吞噬的根本原因。

从第一性原理来看,Harness 根本不是什么“帮模型变聪明的辅助轮”,它是横跨在这两个截然不同宇宙之间的换能器(Transducer)与单向阀门。它是 AI 系统的“麦克斯韦妖”——通过外挂的严格内存管理、类型校验、权限沙箱和防御性编程,强行过滤掉大模型带来的熵增(幻觉与逻辑发散),将概率性的输入,强制压缩、坍塌为现实世界能够接受的确定性状态改变。

只要人类的商业系统依然需要“绝对确定的规则”来运转,我们就永远需要 Harness 来给这个聪明的概率大脑套上物理的缰绳。

第二部分:Vibe Coding 的现实陷阱(绿洲与泥潭)

理论上的物理断层,最终完美映射到了我们日常的开发体验中。如果你在这一波 AI 浪潮中尝试过 Vibe Coding(意图编程),你一定有过截然不同的两种极端体会:有时它像无所不能的上帝,有时它像一个帮倒忙的弱智。

要看透这种极端的根源,我们需要将软件开发的情况精准地分为两类:绿洲场景(静态新项目)与泥潭场景(动态迭代项目)。

1. 绿洲场景: Demo 里的魔法与一键生成

- 本质属性:从零到一,需求明确且冻结(无状态生成)。

这是所有 AI 编程工具最耀眼的时刻。比如你说:“帮我写一个贪吃蛇游戏”,或者“生成一个特定活动的单页应用(Landing Page)”。在这个场景下,你是坐在一张白纸前作画,历史包袱为零。AI Harness 只需要负责把你的“宏大意图”拆解成几个子任务,并行丢给模型,然后把生成的标准代码文件写到磁盘,跑通就结束。这里不需要复杂的“依赖树管理”或“抽象边界保护”,因为模型是在从零构建一个低熵的系统。这就是为什么网络上充斥着无数令人惊叹的一键生成 Demo,它们是基于静态需求的生成力(Velocity)绿洲。

2. 泥潭场景:真实世界的重构与迭代

- 本质属性:状态管理与熵增对抗,历史覆写(强状态演进)。

然而,当你兴奋地把那个一键生成的原型投入真正的商业生产环境,第二天噩梦就开始了。现实中的需求是持续涌入且不断变更的:第一周业务方要“加个用户注册模块”;第二周要“支持微信扫码”;第三周要“扫码失败静默降级到短信验证码,且不能影响邮箱注册逻辑”。

此时,Vibe Coding 迎来了它的致命灾难点:全量覆写(Overwriting)。在一个已经积累了无数前置需求和隐性逻辑的老项目里,一个单纯追求生成速度、缺乏极强状态锁定能力的初级 Harness,为了图省事,极大概率会在加新功能的瞬间,把你底层的用户鉴权逻辑全给改了,导致系统直接崩溃。这就是为什么很多人刚开始觉得 AI 写代码像魔法,但一旦进入项目维护期,就觉得 AI 总在“帮倒忙”。

Harness 的真正价值:泥潭里的手术刀与护城河

正因为真实世界全是不断变更的“泥潭场景”,所以工业界最前沿的 Harness Engineering 探索,早已不再关注“如何让 AI 生成得更快”,而是疯狂内卷于“如何在非线性需求下,安全地‘翻修住着人的老房子’”:

- 上下文隔离与 RAG 检索(Context Isolation): 优秀的 Harness 必须具备项目级上下文解析能力。它不能允许模型随心所欲地读取整个代码库,而是强制要求通过 AST(抽象语法树)技术,精准切分出与新需求相关的模块(如只读

Cart.ts,Product.ts),并下达严格指令:“你只能修改这些文件,绝对禁止碰系统鉴权模块”。 - 外科手术级别的精准修改(Diff-based Editing): Harness 不能允许模型随心所欲地重写整个文件,而是强制要求模型输出标准的 Diff 补丁。然后由 Harness 的解析器去严格校验并精准替换那几行代码。

- 防御性护栏与自动化测试(Evals & tests): 谁来证明新生成的代码没有破坏昨天的业务逻辑?靠人来看几千行 Diff 是不可能的。Harness 必须挂载严苛的自动化测试套件(CI)。模型每次提交修改,Harness 在后台静默运行单元测试,如果发现新需求破坏了老逻辑(Regression),Harness 会自动把错误日志打回给模型,要求它重新修改,直到测试通过才能呈现给人类。

总结来说: 在绿洲里我们造自行车链条,可以尽情甩手;但在泥潭里我们是在给飞行中的飞机换引擎。只要商业需求还在不断变更、系统还需要向下兼容,我们就永远需要 Harness Engineering 来作为系统的“麦克斯韦妖”,用确定性的工程约束(测试、Diff、边界)去降服大模型的非确定性输出,防止它把整个项目搞成一团乱麻。

第三部分:资本的冷酷与 100x 工程师的迷思

当技术杠杆达到百倍甚至千倍时,资本的本能一定是追求极致的“降本增效”。在 Multi-Agent 与高级 Harness 的加持下,一个极具争议的商业命题被推到了台前:如果一个掌握了顶级编排能力的架构师能够指挥 AI 军团,那么是否可以用 20 倍的工资雇佣这一个精英,然后解雇原有的 100 个普通工程师?

从纯粹的算力逻辑看,这似乎顺理成章,但在真实的商业战场上,这种“超级单体”模型会迅速撞上三堵坚硬的墙:

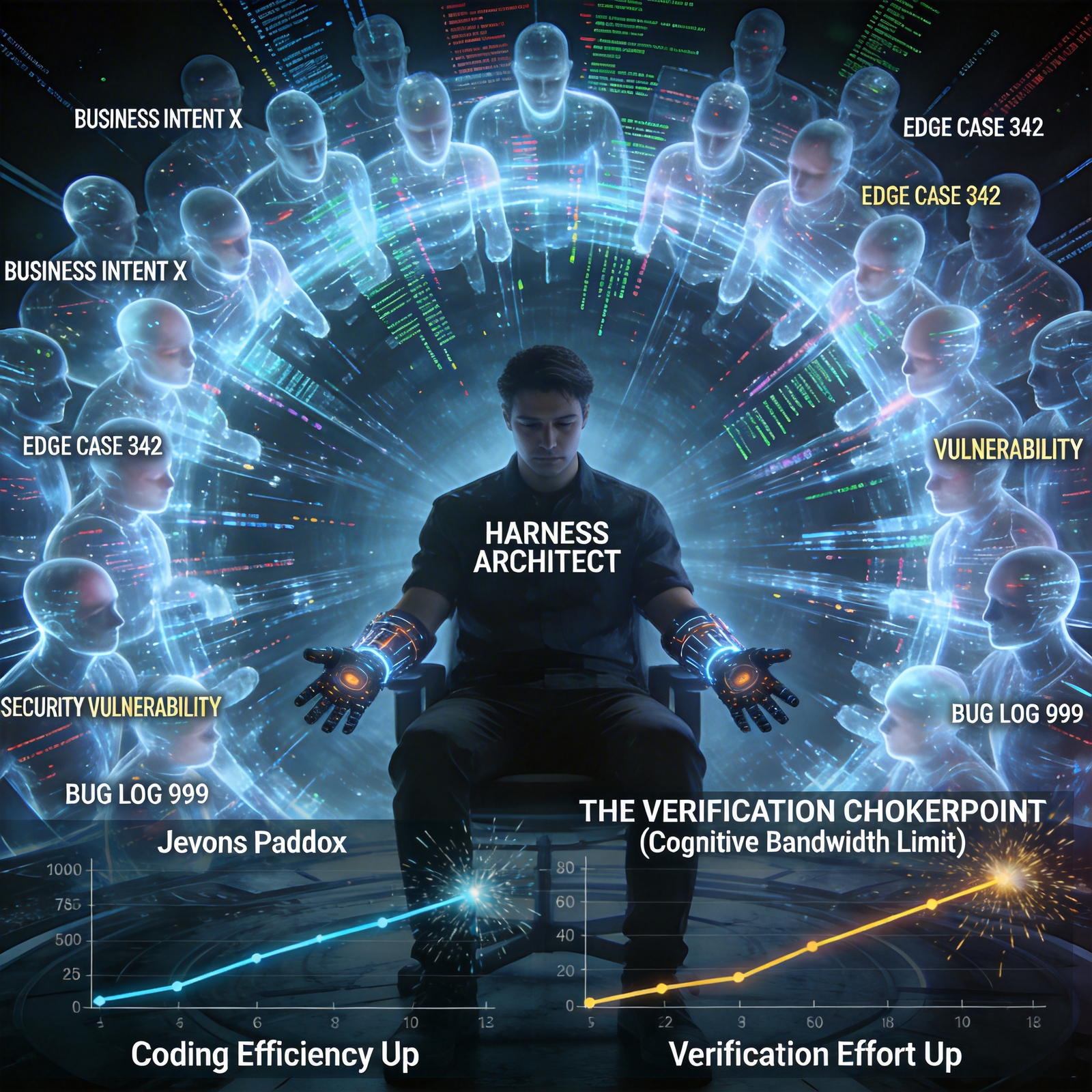

1. 认知带宽的物理极限:生成极易,验证极难

大模型可以瞬间生成 10 万行代码,但谁来验证这 10 万行代码完全契合那 100 个细碎、模糊且不断变更的商业需求? 代码生成的边际成本正在趋近于零,但“定义正确需求”和“承担业务责任”的成本永远不会归零。即使 AI 承担了所有的打字工作,这位超级架构师的时间也很快会被无穷无尽的“需求对齐”、“意图翻译”和“结果审计”彻底填满。人脑的认知带宽是有物理极限的,业务复杂度的洪流会瞬间击穿任何单一固点。

2. 资本最恐惧的噩梦:单点故障(Single Point of Failure)

在软件管理中有一个残酷的概念叫 “公交车因子(Bus Factor)”——即团队里有几个人被公交车撞了,项目就会瘫痪? 如果你把全公司的 Harness 架构、Agent 调度协议和所有的业务黑盒逻辑全部压在一个人身上,这家公司的风险承受力就变成了脆弱的 1。资本追求的是“可控的规模化”,绝不会允许将身家性命系于一个拥有“上帝权限”且不可替代的超级个体。对资本而言,冗余虽然昂贵,但“不可控”才是真正的灭顶之灾。

3. 杰文斯悖论(Jevons Paradox):被吃掉的效率红利

经济学告诉我们:当一项资源的利用效率大幅提高时,最终消耗的总量不会减少,反而会激增。 当开发一个功能的成本从 30 万降到 3000 块时,老板的逻辑通常不是“我省下了那 29 万 7”,而是:“太好了,以前因为嫌贵不敢做的 100 个新业务方向,现在全部给我铺开!” 生产力的爆炸不会导致研发的终结,反而会引发对“高质量交付”更贪婪的需求。竞争对手也在进化,如果你只忙着裁员省钱,而对手利用 100 倍的产出进行功能创新和市场覆盖,你很快就会在产品维度上被降维打击。

结论: 资本不会允许“一个神代替一百个凡人”,但它一定会推动研发团队的剧烈缩编与重组。 未来的团队规模可能从 100 人缩减到 20 人,但这 20 人不再是传统意义上的“搬砖码农”,而是进化成了能够驾驭 AI 集群的、具备极高业务分辨率的精英节点。

第四部分:程序员大重组——“硅基”与“碳基”的混合编排

在 Harness Engineering 统治的未来,我们熟知的“前端、后端、测试、运维”等职业标签将迅速坍塌。这些曾被视为专业壁垒的工种,本质上只是工业时代为了应对人类有限的“认知带宽”而被迫产生的妥协性分工。当 AI 抹平了语法、框架和工具链的门槛,这种分工便失去了存在的物理基础。

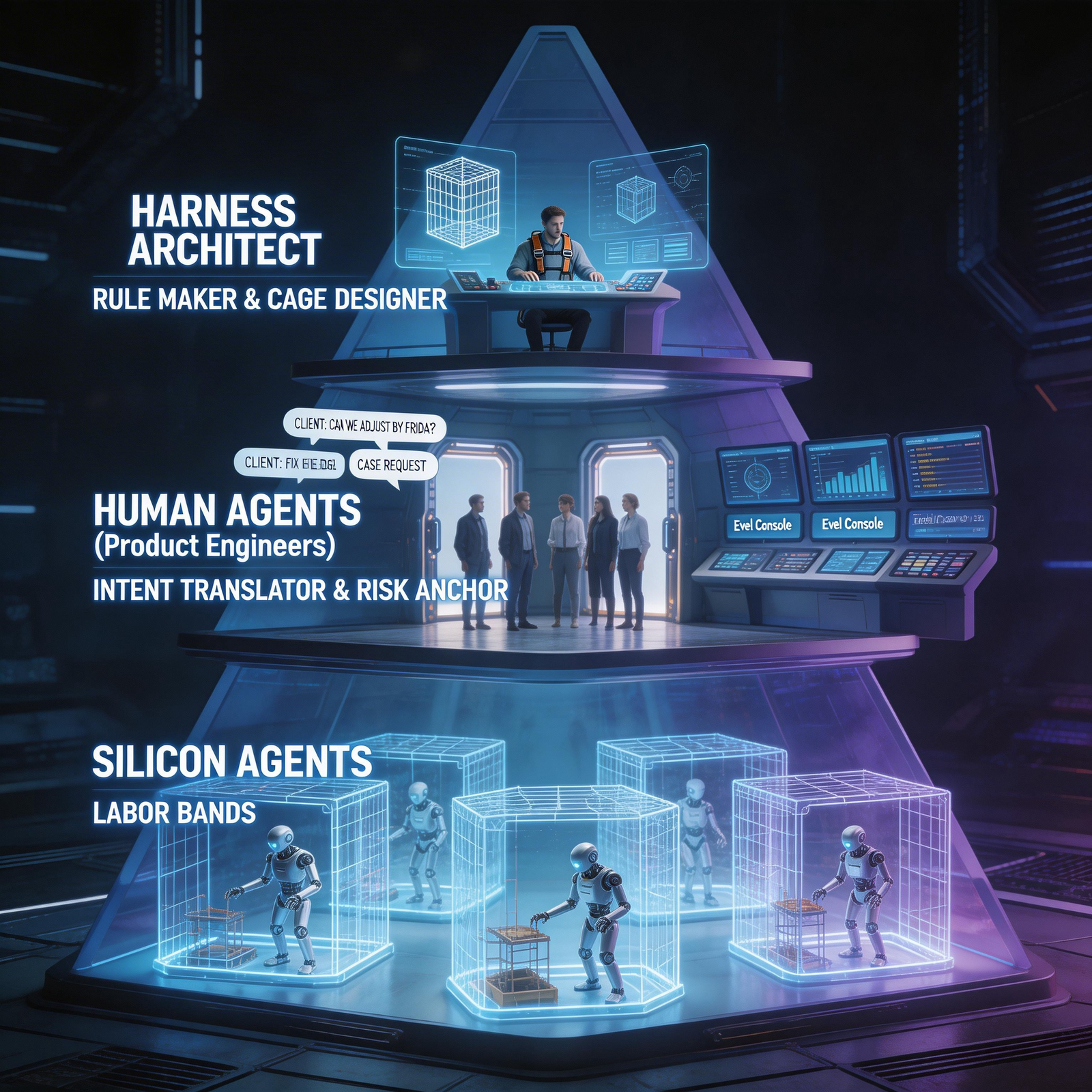

取而代之的,是一场极其冷酷的职业重组:软件开发将演变成一个由“硅基 Agent”(AI 模型)负责执行,而“碳基智能体”(人类工程师)负责决策与兜底的混合编排系统。

即梦生成概念图:未来的软件系统更像一个被严密编排和持续监管的控制中枢。

即梦生成概念图:未来的软件系统更像一个被严密编排和持续监管的控制中枢。

1. 塔尖的“典狱长”:Harness 架构师

未来的核心技术权杖将掌握在极少数的 Harness 架构师手中。他们的工作不再是编写业务代码,而是设计一套精密、冰冷的“AI 运行规范(System Protocols)”。

- 设计“牢笼”: 架构师需要利用沙箱隔离(如 Docker 或 WASM)、权限控制和 API 路由,为 AI 划定绝对的安全边界。

- 制定“法律”: 他们的核心产出是严苛的 Evals(自动化评估体系)。当 AI 生成一段逻辑时,架构师写的代码负责像法官一样进行审判:性能是否达标?是否有安全漏洞?是否满足了所有边界测试?

- 管理“并发”: 他们需要像操作系统内核工程师一样,处理多智能体(Multi-Agent)之间的通信死锁、资源抢占和状态同步。

2. 中坚的“前线操作员”:碳基智能体(Human Agent)

大部分活下来的“普通工程师”并不会消失,而是会转型为一种全新的角色——碳基智能体(Human Agent)。他们不再是代码的搬运工,而是整个分布式计算网络中不可或缺的“高阶容错节点”。

作为碳基智能体,他们的核心价值在于处理那些大模型在数学和物理上无法触达的“业务熵增”:

- 处理“非理性商业潜规则”: “VIP 客户在月底退款必须人工审批且不能发邮件通知”——这种毫无逻辑、从未写进文档、仅存在于酒桌或老员工记忆里的隐性规则,模型永远无法预训练。碳基 Agent 的价值在于:精准捕捉这些“垃圾需求”,并将其结构化地输入给 AI,作为 Harness 的约束条件。

- 充当“责任锚点(Accountability)”: 资本可以忍受 AI 出错,但法律和商业契约不能。当一个涉及千万级资金的支付逻辑上线前,必须有一个具有法律人格的碳基生命在 Harness 工作台上点击“确认”。这个动作不是在写代码,而是在为结果背书。

- 意图的“高分辨率翻译”: 很多时候,业务部门根本不知道自己想要什么。碳基 Agent 需要利用人类特有的同理心、商业直觉和跨部门沟通技巧,将模糊的“感觉”翻译成 AI 能够理解的“指令”。

3. 组织形态的“转轨”

这场重组的本质,是将程序员从“实现者”推向了“监管者”。

在这个混合编排体系中,“普通工程师”的定义被重新改写了。 那些拒绝理解业务细节、只会死守某门语言语法的“纯技术派”,将因为失去了“翻译官”的价值而被彻底淘汰。而那些能够向下理解 Harness 约束、向上对齐商业目标,并能作为 Human-in-the-loop 节点对 AI 进行精准微操的人,将成为公司最核心的资产。

总结来说: 未来的软件团队将呈现一种“沙漏型”结构:顶层是设计系统的架构师,底层是玩命干活的硅基 Agent 军团,而中间那层支撑起整个商业运作的,则是这群负责处理异常、对齐意图并承担最终责任的碳基智能体。

第五部分:未来的公司形态——微服务吞噬“组织架构”

如果说 Harness Engineering 重塑了生产力,那么它对生产关系的终极破坏,将直指商业世界最核心的载体——公司(The Firm)。

诺贝尔奖得主科斯曾在《企业的性质》中指出,公司之所以存在,是因为“市场交易成本”(沟通、寻找契约、建立信任)太高,所以我们需要把人聚在一起,用层级制的行政手段来降低摩擦力。你所谓的“圈子文化”和“面试审核”,本质上都是在进行认知层级的对齐,以确保大家在同一个频道聊天。

即梦生成概念图:组织边界、角色分层与 Agent 协同将共同构成新的社会技术拓扑。

即梦生成概念图:组织边界、角色分层与 Agent 协同将共同构成新的社会技术拓扑。

但当 Multi-Agent 系统接入 Harness 架构后,这种基于人类生物学局限的组织形态将彻底解体。

1. 从“科层制”到“K8s 集群拓扑”

未来的公司将不再是一张树状的人事架构图,而是一张冷酷的 K8s(Kubernetes)集群拓扑图。

传统的部门墙(前端组、后端组、产品部)将被彻底推倒,取而代之的是一个个“领域驱动”的 Agent 细胞单元。在这种形态下,沟通摩擦力确实降到了无限趋近于零:

- 零摩擦的上下文: 两个 Agent 之间不需要开长达两小时的对齐会议,它们可以通过毫秒级的 RPC 调用和预定义的 JSON 协议完成意图传递。

- 机器级的冷静: 它们没有情绪、不玩办公室政治、不向上管理,它们唯一的使命就是完成 Harness 设定的状态转移。

2. “限界上下文”:为什么不能有“全局共享大脑”?

你可能会设想一个“全知全能、共享全局上下文”的公司大脑,但从系统工程的第一性原理来看,那是毁灭性的灾难。

为了防止系统因过载而崩溃,Harness 架构师会采用 “限界上下文(Bounded Contexts)” 策略:

- 信息的物理隔离: 负责财务审计的 Agent Swarm 绝对无法读取用户社交数据的原始上下文。这种隔离不是为了隐私,而是为了防止噪声(Noise)。

- 按需订阅(Pub/Sub): Agent 之间不再是“读心术”,而是通过极其高效的消息队列。只有当某个状态发生变更(如用户下单成功),相关的 Agent 才会收到推送并被激活。

- 这意味着: 公司变成了一个高度模块化、可插拔的精密机器。

3. “Evals 评估”取代“面试审核”

传统的招聘流程——简历筛选、算法面试、价值观考察——在未来将显得极其低效且主观。

在 Harness 驱动的公司里,“录用”变成了一种持续的、自动化的 Evals 流程。 无论是引入一个新的 AI 模型,还是接入一个新的“碳基 Agent(人类)”,Harness 架构师都会直接将其丢进沙箱环境:

- 压力测试: 在 10,000 个边缘案例中,你的决策准确率是多少?

- 合规性检查: 你的输出是否会触发安全红线?

- 性能评估: 你的计算成本和 Token 消耗是否在预算内? 只有跑通了这套“生存测试”的 Agent,才会被赋予线上权限。这是一种比人类面试严苛万倍、却也公平万倍的“算法准入机制”。

4. 幽灵般的管理者:Supervisor Agent

当所有的执行层都变成了硅基与碳基的混合体,传统意义上的“中层经理”将彻底消失。

取而代之的是 Supervisor Agent(监工智能体)。它们隐藏在 Harness 系统的监控面板后,实时扫描整个集群的健康度:

- 熔断机制: 一旦发现某个 Agent 陷入逻辑死锁或开始产生大面积幻觉,Supervisor 会瞬间切断其 API 访问权限,并触发回滚(Rollback)。

- 资源调度: 根据当前的业务负载,动态地增减 AI Agent 的算力分配。

终局画面: 公司不再是一群人通过语言和 PPT 维系的社会组织,而是一个全自动运行的巨型状态机。在这个机器里,Harness 架构师是那个唯一的“集群管理员(Cluster Admin)”。

沟通的摩擦力确实消失了,但系统的复杂度却呈指数级上升。在这个冷酷、高效、瞬息万变的数字实体中,人类该如何自处?

结语:生存指南——如何完成你的“技能洗点”?

在这场被 AI 彻底重塑的范式转移中,最危险的行为莫过于守着旧时代的地图,试图寻找新世界的出口。如果你依然把自己定义为一个“写代码的工匠”,那么你正处在被大模型吞噬的重灾区。

要从“代码翻译官”跃迁为 Harness 架构师 或高阶的 碳基智能体,你需要完成一场极其痛苦但必须经历的“技能树重置”。以下是为你准备的四份职业生存清单:

1. 从“实现(Implementation)”转向“契约与评估(Evals)”

过去,衡量程序员的标准是“能不能写出复杂的算法”;未来,标准将变成“能不能精准地定义什么是对的”。

- 停止迷恋: 不要再死磕某种编程语言的冷门语法或最新的前端框架 API。

- 立刻学习:

- 编写评估集(Evals): 学习如何用代码去“测试”一段由 AI 生成的非确定性代码。Harness 的核心就是验证逻辑。

- 定义 API 契约: 熟练掌握 JSON Schema、OpenAPI 等规范。AI 的输出是概率性的,但它与系统交互的接口必须是 100% 确定 的。

2. 深挖底层系统原理:做 AI 的“操作系统工程师”

大模型越强大,越像一个不受控的超级 CPU。为了降服它,你需要拥有设计“操作系统”的底层思维。

- 核心武器库:

- 隔离与沙箱(Sandboxing): 学习 Docker、WASM(WebAssembly)等技术。绝对不要让 AI 直接在你的宿主机上运行代码,学会如何为它建造“牢笼”。

- 并发与锁(Concurrency Control): 当多个 AI Agent 同时修改系统状态时,如何防止竞态冲突?这是未来 Harness 架构师的基本功。

- 可观测性(Observability): 学习如何监控一个“黑盒”。当 AI 在生产环境发疯时,你必须能瞬间定位到是哪一步 Prompt 或哪个检索库出了问题。

3. 提升“业务分辨率”:业务细节就是你的护城河

AI 懂全世界最通用的真理,但它绝对不懂你们公司那些“不讲道理”的业务潜规则。

- 核心策略: 深入到业务最核心的泥潭里去。去搞懂复杂的退款逻辑、去理清供应链的死锁、去理解合规部门的审计底线。

- 价值体现: 当 AI 试图重构掉一段“看起来不优雅但解决了关键业务漏洞”的代码时,只有作为“高分辨率碳基节点”的你能精准拦截。那些“脏活累活”和“异常处理”就是你对抗 AI 的绝对领域。

4. 将 Prompt 视为工程代码(Prompt as Config)

彻底告别“写散文”式的提示词(例如:“请帮我写个漂亮的页面”)。作为架构师,你必须把 Prompt 视作系统级配置文件。

- 工程化实践: 学习使用结构化标记(XML, Markdown)来构建严密的 System Prompt。为 Agent 设定明确的指令路由、退出条件和错误处理机制。学会如何精准地进行上下文管理(Context Management),只给 AI 喂入刚好足够的知识,防止它在信息的海洋里溺水。

最后的忠告:不要成为翻译,要成为法官

这场变革不是要消灭程序员,而是要逼着我们完成一次跨维度的角色升维。

- 过去: 我们是代码的打字员,为机器服务。

- 未来: 我们是系统的驯兽师、典狱长和法官。

你提供牢笼(沙箱边界),你制定法律(Evals 与契约),你洞察人情(业务边缘场景),然后放手让笼子里的野兽(AI)去拼命干活。

这不仅是一场生存战,更是一次前所未有的解放。当你不再被琐碎的语法和 Bug 奴役时,你才真正获得了掌控复杂系统的权力。欢迎来到 Harness Engineering 的时代。